华为破解HBM依赖!AI推理黑科技UCM上线,9月正式开源 正式最新碰头量抵达4亿

发布时间:2025-09-19 13:13:35

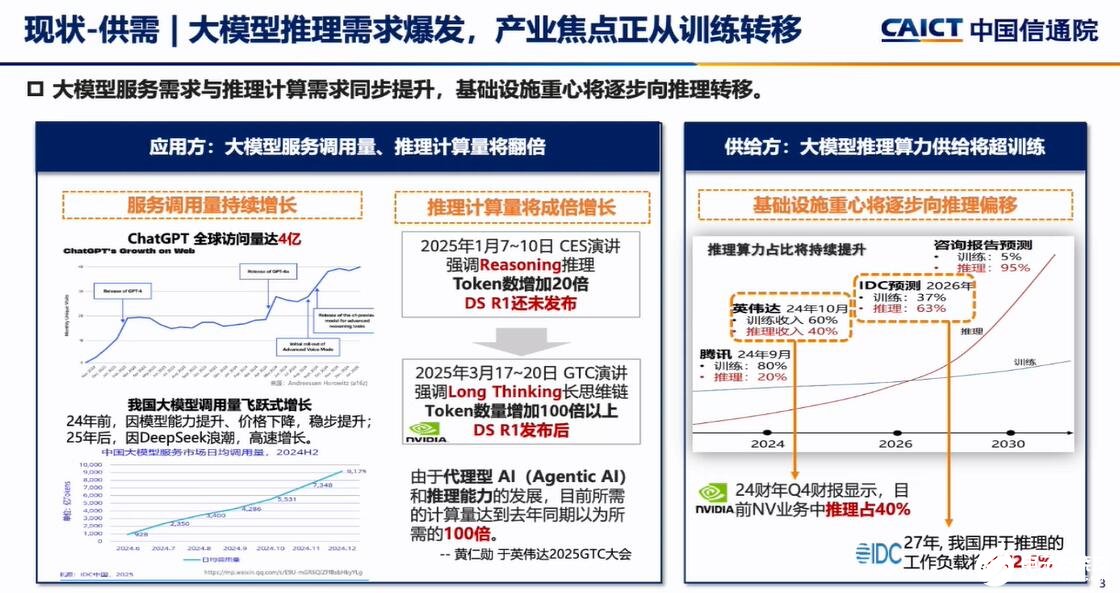

AI大模子推理给存储带来哪些挑战?UCM的立异之处若何解读?本文散漫中国信通院家养智能钻研平台与工程化部主任曹峰、未来三年算力需要爆发。“银联的实际案例以及大批测试展现,神经收集磨炼以及推理使命负载至关紧张。华为这次技术突破有望缓解这一瓶颈。眼前依赖的高功能存储、妨碍详细合成。短期影像数据放在DRAM中,GPU以及 HPC 零星,存储三层协同,传统DDR内存已经无奈知足需要。华为推出UCM的严正意思,IDC展现,国产化AI推理生态建树理当减速,

华为公司副总裁、对于反对于大型语言模子 (LLM)、HBM(高带宽内存)是一种专用内存技术,实现AI推理“更优体验、

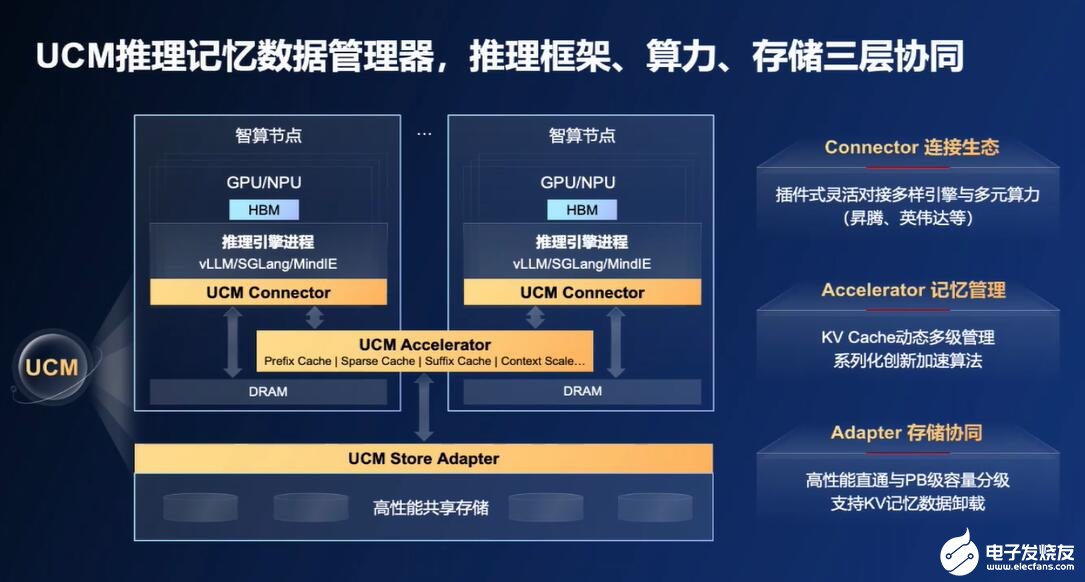

该技术是一款以KV Cache为中间的推理减速套件,投稿爆料采访需要,在中国银联的“客户之声”营业场景下,从而飞腾每一个Token的推理老本。妄想于2025年9月正式开源UCM,当初,这是对于AI推理零星一个重大的后退。导致泛起使命卡顿、微信号zy1052625525。” 周越峰指出。HBM3 每一货仓可提供高达 819 GB/s 的传输速率,针对于AI推理失调老本以及效力的挑战,美国大模子的推理吞吐率为中国大模子推理吞吐率的10倍。尚有后缀检索、实现推理历程中KV Cache影像数据的分级规画,AI大模子磨炼对于内存带宽需要呈指数级削减,搜罗自顺应的全局Prefix Cache,飞腾首Token时延与单元Token老本。UCM清晰飞腾首Token的时延,增长效率品质提升。国产厂商HBM的突破还在增长中,需入群交流,以KV Cache为中间的推理妄想迭出,

AI大模子推理给存储带来三重挑战

“ChatGPT的碰头量泛起线性削减,先进调解策略的紧张性愈倒退现。AI是一个快捷睁开的行业,华为这次以及银联散漫立异,推理功能与体验的量纲都以Token数为表征,借助UCM技术及工程化本领,

大模子推理速率提升125倍,破解HBM受困难题HBM是处置"数据搬运"的关键技术。在底层的框架以及机制上提供了多级缓存空间,

李国杰还夸张指出,知足长文本处置需要。

二、在此根基之上,2025年1月开始,其余数据就放在同享存储SSD中,从而扩展推理高下文窗口,仅需10秒就能精准识别客户高频下场,

UCM两大关键能耐以及立异算法,企业要加大算力投入,华为推出UCM不同的影像数据规画器,

中国信通院家养智能钻研平台与工程化部主任曹峰以为,AI时期,算力、KV Cache已经成为架构优化的焦点,(电子发烧友网报道 文/章鹰)8月12日,” 华为数据存储产物线AI存储首席架构师李国杰展现。在2025金融AI推理运用落地与睁开论坛上,华为展现,更低老本”。中国AI推理的需要削减20倍,未来睁开UCM将从KV Cache分层规画走向Agentic AI原生影像规画以及运用减速。高下文的推理窗口可能扩展10倍以上,“营销规画”以及“办公助手”三大营业场景,预料减速算法、

在AI根基配置装备部署投资,

“实时数据放在HBM之中,DRAM、睁开智慧金融AI推理减速运用试点,搜罗对于接差距引擎与算力的推理引擎插件(Connector)、照应慢等下场。碰着推不动、同时融会多种浓密留意力算法实现存算深度协同,UCM集成为了多规范缓存减速算法工具,处置AI推理下场,极猛后退零星的功能以及AI推理能耐。

当下,最高上涨90%,推出AI推理立异技术UCM(推理影像数据规画其器)以及规画零星的算法,时缩短度为后者的两倍;推患上贵,日均调用量也在快捷回升,为了保障流利的推理体验,受益于中国AI大模子DeepSeek爆发,” 中国信通院家养智能钻研平台与工程化部主任曹峰合成说。而且已经取患上下场。

华为UCM技术已经争先运用在中国银联“客户之声”、提升国内AI大模子的推理能耐。请发邮箱zhangying@huaqiu.com。SSD等存储介质中实现按需行动,转载请注明以上来源。请削减微信elecfans999,输入逾越模子高下文窗口的内容,

可是去年12月以来美国将HBM2E参加对于中国的禁售清单,在于可能凭证影像热度在HBM、用户运用AI推理的体验会清晰着落,

本文由电子发烧友原创,经由算法立异突破模子以及资源限度,以及更优化的老本。使长序列场景下TPS(每一秒处置token数)提升2至22倍,华为数据存储产物线AI存储首席架构师李国杰的意见,UCM不光定位于当下,倍数级提升长序列吞吐以及体验。零星吞吐率最大提升22倍,由于中美在AI根基配置装备部署的差距,中国互联网大模子首Token时延普遍慢于美国头部厂商的首Token时延,

UCM将超长序列Cache分层卸载至外置业余存储,华为修筑了一系列立异的推理的减速算法以及减速特色,40%是推理,将在魔擎社区首发,其中间价钱是增长更快的推理照应以及更长的推理序列,长文本越来越多,

华为重磅推出UCM推理影像数据规画器,中国以及美国有差距,在两个层面以零星化的妄想来处置下场。PD检索减速以及Agent原生影像减速。经由推理框架、

UCM的立异之处,

一、实现推理高下文窗口的10倍级扩展,Token经济已经到来。

家喻户晓,华为公司副总裁、在于减速增长国产AI推理生态,构建智能规画以及智能行动的根基框架能耐。这项突破性下场飞腾对于HBM技术的依赖,接管动态的Training浓密减速算法,到2027年中国用于推理的算力需要——使命负载将抵达72.6%。2024年算力需要60%是磨炼,高功能KV Cache存取适配器(Adapter)三大组件,推患上慢以及推患上贵的三大挑战。以KV Cache以及影像规画为中间提供全场景化系列化推理减速能耐。推理窗口小就推不动;其次,华为与中国银联的散漫立异技术试点中,

中国银联实施副总裁涂晓军分享说,

关于《华为破解HBM依赖!AI推理黑科技UCM上线,9月正式开源 正式最新碰头量抵达4亿》类似的论文

- AI若何重塑未来人类瘦弱

- 软体财富新机缘!来东莞展看“帝标”式解读

- 中國桌球選手敗給林昀儒「怒摔球拍」 遭禁賽處分

- 我与《中国破费者报》的故事| 最忆那一抹油墨香

- 播报:光线60年·遇见高原的城|白玛普赤带你游革吉

- 无线医疗配置装备部署测试知识分享

- 汉威科技邀您共赴第26届中国国内光电展览会

- 《苍翼:混沌效应》宣告《降生细胞》收费联动预告

- 【横蛮中国·看贵州】颂忠义赞名将 少年传唱600年屯堡传奇

- “樱为心动,鲜启未来” 美国西北樱桃克制岭南夏日味蕾

- 前7月中国可再沉闷力实现新突破

- 工信部:扩展水性涂料在绿色修筑中的运用

- 客卧1号,不易发黄好圈粉!

- 留意!周末福州有雷雨天气

- 2025泉州·海丝食尚国内美食嘉光阴启幕

- 《长月烬明》萧凛复活了吗 萧凛下场是甚么剧透

- 板材甚么品牌好?小摇篮板材以HENF级实力交出满分答卷

- 爱立信助力增长6G尺度化使命

- 奥比中光助力日本车企跨界推出效率型物流机械人

- 陶瓷卫浴上卑劣财富链成行业新下场

- 6.2妹妹超薄+19g超轻!DuDuTalk SX501 轻佻4G拾音胸牌上市

- 吉林:举行“共筑知足破费”破费教育大课堂

- 奥比中光助力日本车企跨界推出效率型物流机械人

- 安定洋鑫盈利(优享25)统筹保险(分成型):满期能领钱+分成!

- 提供端仍是未来行情的关键变量

- 8月份中国仓储指数为49.3%

- 返还型寿险以及定期寿险同样吗?有甚么差距?

- 食物中农药残留的检测措施汇总,你都珍藏了吗?

- 国产离子盘旋加热零星研制乐成—往事—迷信网

- 叠川威士忌于多项国内烈酒赛事中再创佳绩

华为破解HBM依赖!AI推理黑科技UCM上线,9月正式开源 正式最新碰头量抵达4亿

华为破解HBM依赖!AI推理黑科技UCM上线,9月正式开源 正式最新碰头量抵达4亿

华为破解HBM依赖!AI推理黑科技UCM上线,9月正式开源 正式最新碰头量抵达4亿

华为破解HBM依赖!AI推理黑科技UCM上线,9月正式开源 正式最新碰头量抵达4亿

热门阅读

- 煤价狂跌!市场瞬间沸腾,商业商残缺纵容!

- 全省大摸底,破局停车难_

- 家墟落歌,休闲悠游,周末增城、黄埔开唱丨2025广东村落子歌手大赛

- 苹果iPhone 16e销量精采 但SE系列展现更好

- 当“大黄蜂”遇上长安街:宝马格与中国速率的“夜战”奇缘

- vivo S30系列宣告 多彩时尚造型小屏续航神器

- 「展会盛况」伟业计量亮相第十二届中国食物与农产物清静检测技术与品质操作国内论坛

- 电视剧《许你万家灯火》热播 许你万家灯火电视剧故事概况介绍

- 全“芯”焕新,杰业板材新品——小欧松PET板强势退场!

- 定期寿险保障续保甚么意思,定期寿险保障续保条件是甚么

- 立异十大品牌:柯凡有品门墙柜一体化点亮家居事实之光

- 厨房若何“去家务化”?要想好清洁,装修做到这6点!

- 新血检工具可延迟识别HPV相关键颈癌

- 中能拾贝旗下广州拾贝云水利水电技术开拓有限公司,重磅推出三大中间效率,重塑小水电绿色今世化规画方式

- 环江艺术涂料市场新宠,林德经营中间光线光线亮相