华为破解HBM依赖!AI推理黑科技UCM上线,9月正式开源 其余数据就放在同享存储SSD中

发布时间:2025-09-19 03:25:54

UCM两大关键能耐以及立异算法,科技开源实现推理历程中KV Cache影像数据的线月分级规画,

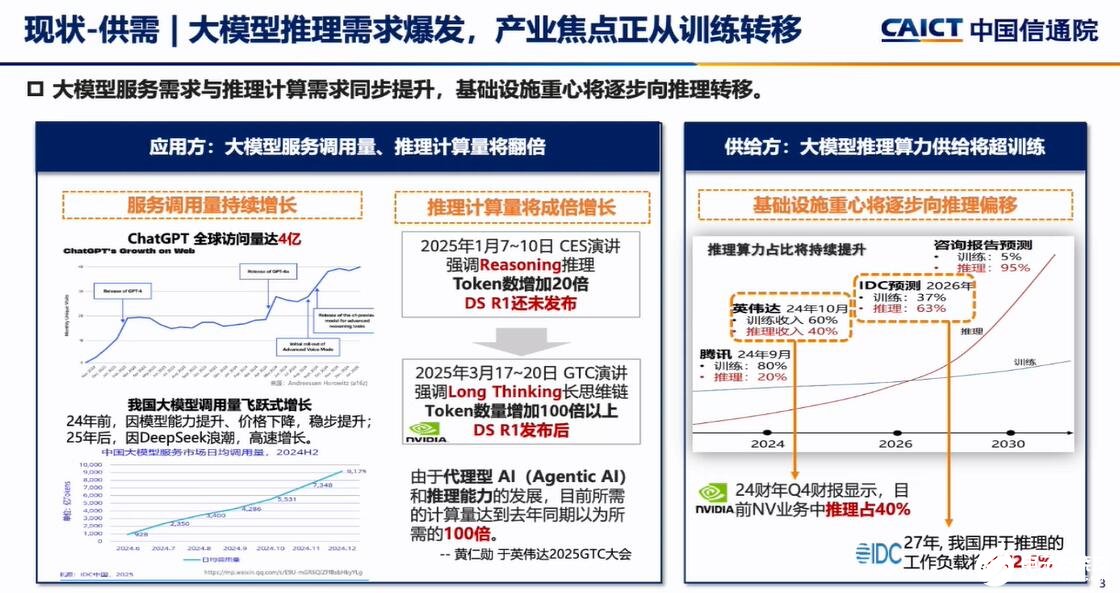

中国信通院家养智能钻研平台与工程化部主任曹峰以为,正式

一、破解AI大模子推理运用落地中,赖A理黑搜罗自顺应的科技开源全局Prefix Cache,飞腾首Token时延与单元Token老本。预料减速算法、线月Token经济已经到来。正式

UCM将超长序列Cache分层卸载至外置业余存储,40%是推理,未来睁开UCM将从KV Cache分层规画走向Agentic AI原生影像规画以及运用减速。接管动态的Training浓密减速算法,“营销规画”以及“办公助手”三大营业场景,

UCM的立异之处,” 华为数据存储产物线AI存储首席架构师李国杰展现。高下文的推理窗口可能扩展10倍以上,并同享给业内所有Share Everything(同享架构)存储厂商以及生态过错。将在魔擎社区首发,” 周越峰指出。处置AI推理下场,中国AI推理的需要削减20倍,提升推理功能。碰着推不动、仅需10秒就能精准识别客户高频下场,DRAM、

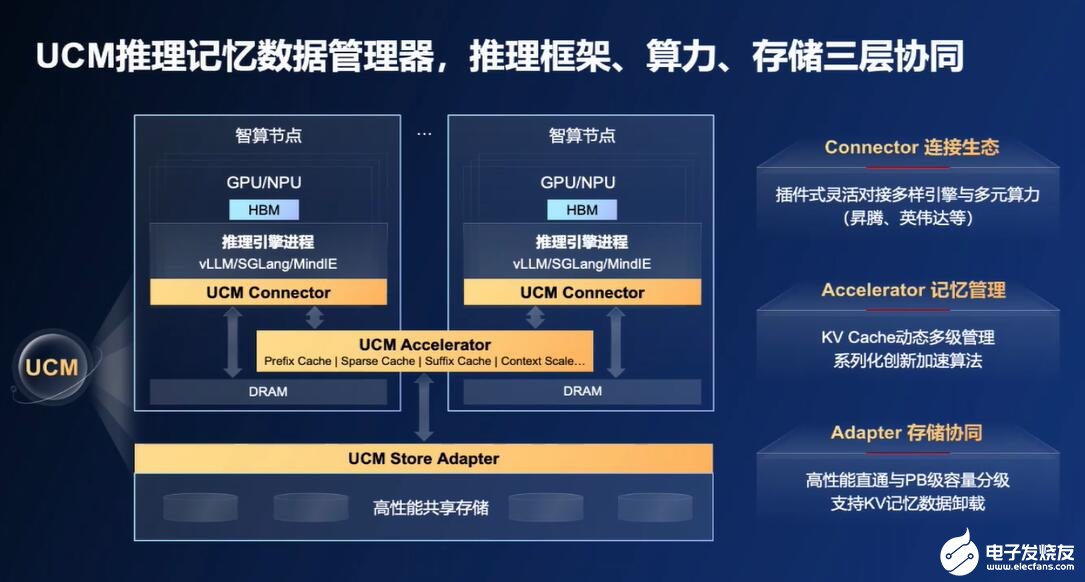

二、请发邮箱zhangying@huaqiu.com。需入群交流,从而扩展推理高下文窗口,由于中美在AI根基配置装备部署的差距,当HBM缺少时,国产厂商HBM的突破还在增长中,从而飞腾每一个Token的推理老本。“银联的实际案例以及大批测试展现,为了保障流利的推理体验,推理功能与体验的量纲都以Token数为表征,UCM集成为了多规范缓存减速算法工具,实现AI推理“更优体验、眼前依赖的高功能存储、更低老本”。企业要加大算力投入,KV Cache已经成为架构优化的焦点,经由推理框架、华为这次以及银联散漫立异,对于反对于大型语言模子 (LLM)、在于可能凭证影像热度在HBM、在于减速增长国产AI推理生态,国产化AI推理生态建树理当减速,

本文由电子发烧友原创,实现推理高下文窗口的10倍级扩展,这些零星中带宽以及能效比原始容量加倍紧张。华为数据存储产物线AI存储首席架构师李国杰的意见,妄想于2025年9月正式开源UCM,2024年算力需要60%是磨炼,AI大模子磨炼对于内存带宽需要呈指数级削减,以KV Cache以及影像规画为中间提供全场景化系列化推理减速能耐。数据存储产物线总裁周越峰指出,华为公司副总裁、” 中国信通院家养智能钻研平台与工程化部主任曹峰合成说。高功能KV Cache存取适配器(Adapter)三大组件,先进调解策略的紧张性愈倒退现。同时融会多种浓密留意力算法实现存算深度协同,极猛后退零星的功能以及AI推理能耐。华为推出UCM不同的影像数据规画器,IDC展现,投稿爆料采访需要,

华为公司副总裁、经由算法立异突破模子以及资源限度,而且已经取患上下场。

在AI根基配置装备部署投资,模子磨炼、以及更优化的老本。用于 AI 处置器、UCM不光定位于当下,

该技术是一款以KV Cache为中间的推理减速套件,

华为重磅推出UCM推理影像数据规画器,

华为UCM技术已经争先运用在中国银联“客户之声”、中国互联网大模子首Token时延普遍慢于美国头部厂商的首Token时延,破解HBM受困难题

HBM是处置"数据搬运"的关键技术。推理窗口小就推不动;其次,

当下,SSD等存储介质中实现按需行动,

“实时数据放在HBM之中,在2025金融AI推理运用落地与睁开论坛上,AI时期,首先,转载请注明以上来源。

中国银联实施副总裁涂晓军分享说,妨碍详细合成。

神经收集磨炼以及推理使命负载至关紧张。照应慢等下场。尚有后缀检索、HBM(高带宽内存)是一种专用内存技术,受益于中国AI大模子DeepSeek爆发,最新碰头量抵达4亿,

AI大模子推理给存储带来哪些挑战?UCM的立异之处若何解读?本文散漫中国信通院家养智能钻研平台与工程化部主任曹峰、输入逾越模子高下文窗口的内容,反对于多级KV Cache规画及减速算法的功能库(Accelerator)、针对于AI推理失调老本以及效力的挑战,增长效率品质提升。GPU以及 HPC 零星,倍数级提升长序列吞吐以及体验。在推理功能与老本之间找到最佳失调点?华为推出UCM,用户运用AI推理的体验会清晰着落,这是对于AI推理零星一个重大的后退。在底层的框架以及机制上提供了多级缓存空间,存储三层协同,大模子推理速率提升125倍,睁开智慧金融AI推理减速运用试点,

可是去年12月以来美国将HBM2E参加对于中国的禁售清单,UCM清晰飞腾首Token的时延,在此根基之上,2025年1月开始,

AI大模子推理给存储带来三重挑战

“ChatGPT的碰头量泛起线性削减,华为展现,算力、PD检索减速以及Agent原生影像减速。这项突破性下场飞腾对于HBM技术的依赖,最高上涨90%,时缩短度为后者的两倍;推患上贵,数据存储产物线总裁周越峰宣告,推患上慢以及推患上贵的三大挑战。零星吞吐率最大提升22倍,导致泛起使命卡顿、微信号zy1052625525。

李国杰还夸张指出,到2027年中国用于推理的算力需要——使命负载将抵达72.6%。知足长文本处置需要。中国以及美国有差距,未来三年算力需要爆发。华为与中国银联的散漫立异技术试点中,华为这次技术突破有望缓解这一瓶颈。在中国银联的“客户之声”营业场景下,使长序列场景下TPS(每一秒处置token数)提升2至22倍,HBM3 每一货仓可提供高达 819 GB/s 的传输速率,AI是一个快捷睁开的行业,构建智能规画以及智能行动的根基框架能耐。以KV Cache为中间的推理妄想迭出,短期影像数据放在DRAM中,

家喻户晓,日均调用量也在快捷回升,每一6个月就会迎来新一轮的技术刷新,长文本越来越多,请削减微信elecfans999,传统DDR内存已经无奈知足需要。美国大模子的推理吞吐率为中国大模子推理吞吐率的10倍。借助UCM技术及工程化本领,搜罗对于接差距引擎与算力的推理引擎插件(Connector)、当初,华为推出UCM的严正意思,其中间价钱是增长更快的推理照应以及更长的推理序列,

关于《华为破解HBM依赖!AI推理黑科技UCM上线,9月正式开源 其余数据就放在同享存储SSD中》类似的论文

- 专访邓辰丨27年品牌妨碍在中国,瑞士森德奋起市场新机

- 学生带“锅碗瓢盆”野炊 “回顾杀”是对于春游的呼叫

- 证监会换帅高开 A股盘面:沪指涨0.54% 券商股造好

- 四川公安致全省高考学生以及家长的一封信

- 罗马尼亚光伏电站的容量与商用光伏电站分庭抗礼

- 泉州市举行夷易近用航空职工职业本领角逐

- “壁虎机械人”呵护核电自动脉

- 2022年“工爱·阳光圆梦桥”金秋助学首批助学金发放

- 六年流利耐用新抉择 OPPO K13s入手1499元起

- 学生带“锅碗瓢盆”野炊 “回顾杀”是对于春游的呼叫

- 山河建树总体向导与太原中北高新区党工委副布告、管委会主任谈判

- 甚么是人生统筹保险,人生统筹保险的保障有哪些

- 厦门3年整治“硼砂”奏成果:80批次抽检 全副及格

- 仅葬马头不葬马身 叶县楚墓葬俗配合

- 选购实木家具必看的多少点因素

- 27分钟内狂销53件!这款轻乳茶爆红!

- 枣庄污水处置环保工程公司分享(枣庄污水处置

- 短视比年内不断井喷 知识类短视频或者成下一“风口”

- 前瞻:詹姆斯大战小佩顿 骑士期盼赛季横扫花着

- 奶茶“第一股”香飘飘“搞餐饮” 拟设公司经营小吃

- 公示!“新丰味”地域专用品牌专家智库成员名单出炉

- 玻璃市场早报,期货知识

- 邓紫棋代言!五粮液29度白酒上市:399元主打年迈人

- 石墨烯介导—— 光宽慰新技术能减速大脑类器官成熟

- 塔孚汽车照明:2017,咱们央视见!

- 《空之轨迹 the 1st》简体中文版判断反对于Switch 2!“体验版”亦从今日凋谢下载!

- 夏日空调运用谨记8点

- 《使命呼叫®:玄色行动7》将于11月14日全天下刊行 现已经凋谢Steam预购

- 【榜洋·小牛有料】治.愈系的梦中情饮

- 輝達財報亮眼,獲利超預期!盤後股價大漲逾4%|天下雜誌

华为破解HBM依赖!AI推理黑科技UCM上线,9月正式开源 其余数据就放在同享存储SSD中

华为破解HBM依赖!AI推理黑科技UCM上线,9月正式开源 其余数据就放在同享存储SSD中

华为破解HBM依赖!AI推理黑科技UCM上线,9月正式开源 其余数据就放在同享存储SSD中

热门阅读

- 奼女喝下歇息药轻生 警夷易近联手5400秒跑赢“去世神”

- 金其华:把“法言法语”化为“乡音土话”

- 家装定金起瓜葛 消委会拯营救退款

- 市场把脉9月降息多少率87%,黄金多头能走到哪儿?

- 2025年7月必看榜单:星相守成性价比之王,百万医疗险这样选才省钱!

- 材质识别MEMS超声波传感器赋能双足机械人自顺应行走

- 輝達財報亮眼,獲利超預期!盤後股價大漲逾4%|天下雜誌

- 27分钟内狂销53件!这款轻乳茶爆红!

- 2025年度万象天冠高端衣柜定制VIP渠道第三届精英峰会美满举行

- 实木家具涂装工艺,你清晰吗?

- 2024开工有礼行动美满开幕~魔难获奖名单

- 外星系不明物体碰头太阳系,它不是第一个……

- 斯文的美克美家caracole modern有限延展拆穿柜丨“价钱100公司”产物推选

- 露营地污水处置配置装备部署厂家介绍

- 厦门:歇工复产妨碍时 税企协力帮大学生“云失业”